« C’est le propre de l’homme de se tromper; seul l’insensé persiste dans son erreur. » CICÉRON

Un instant et tout bascule.

Une erreur de calcul, d’appréciation, de jugement et la journée peut s’en trouver gâcher pour de bon. Confronté à des moments où un choix s’impose, il faut aller de l’avant, choisir une option qui nous sorte de l’immobilisme, du néant, sans toutefois choisir ce qui est malsain ou inadéquat.

Commentaire 1 : Décider d’avancer pour ne pas rester bloquer devant un obstacle qui nous empêche d’aller là ou nous voulons aller, se heurter à cet obstacle ou y échoir s’il s’agit du vide ou d’un mur, est-ce plus souhaitable que de ne pas avancer dans la direction qui se présente directement à nous, et qui en l’état est condamné, pour plutôt trouver une autre voie, une sortie de l’impasse ? S’arrêter devant l’obstacle pour réfléchir, faire demi-tour, emprunter un chemin détourné, n’est-ce pas une progression plus souhaitable que celle de celui qui avance sur l’obstacle, sans garantie de le surmonter ? Bien entendu, faire le pari de franchir l’obstacle peut-être considéré comme une initiative courageuse. La pensée expectative de l’homme toutefois lui permet de distinguer ce courage, cette énergie, force et envie d’action de la témérité la plus nuisible.

Le choix ne porte pas simplement sur la décision de faire ou de ne pas faire, mais également sur une pluralité d’actions imaginables, sur le « que-faire ? ». Ses imaginables ne sont pas (pour) tous des envisageables. Ces actions imaginables (options), doivent être des décisions sensées et justifiables au vu de l’objectif visé. L’objectif est l’origine du choix et le moteur de l’action. Celui qui effectue le choix prédéterminant l’action pèse le pour et le contre. Cette balance est notre raisonnement expectatif.

Enfant, nous apprenons qu’il faut s’arrêter pour mieux observer et ainsi ne pas risquer de s’engouffrer dans un piège, prendre du recul pour voir plus loin, reculer pour avancer.

Le raisonnement expectatif de l’homme est le contraire du coup de tête, du manque de discernement dans la prise décision et du manque de considération des éléments. Il consiste en l’attente, la recherche d’une solution, non au fait de s’engager sans une claire vision préalable de la situation. L’expectatif se base ainsi sur une observation accrue, une analyse de ce qui se joue et surtout sur une capacité à déterminer les potentialités, à jauger les probabilités.

Nous agissons donc en vue d’un résultat préétabli, selon nos intérêts, nos convictions, considérant les risques, y compris l’imprévu/l’imprévisible, et suivant une raison qui, malgré l’individualité de chaque raisonnement, n’échappe pas aux canons d’une certaine logique. L’éducation transmise, mais aussi celle que l’on se forge, l’autodiscipline et l’expérience, y joue certainement un rôle primordial.

Puisque nous humains tendons à déléguer de plus en plus de tâches, de métiers et de responsabilité à des tiers, il se pose à nous la question du transfert de notre force exécutrice, et de notre puissance de choix décisionnaire. Et puisque nous tendons à déléguer de plus en plus de nos tâches et de nos décisions à des machines, il se pose également à nous la question du transfert de la responsabilité humaine vers des systèmes automatisés. Aujourd’hui, dans quasiment tous les domaines, l’homme confie à des automatismes élaborés par ces soins des missions où cet automatisme est à la fois l’exécutant mais aussi le décideur. Ce n’est plus l’homme qui, d’une pression sur une manette, intime à la machine une manœuvre précise, mais la machine qui se commande toute seule.

Conçu pour exécuter une tâche précise, mais surtout pour prendre toutes les décisions adaptées en vue de l’accomplissement de cette tâche, le système automatisé est à la fois le véhicule et le pilote, l’organisateur et le participant, l’ordinateur contrôlant le logiciel, le metteur en scène et l’acteur.

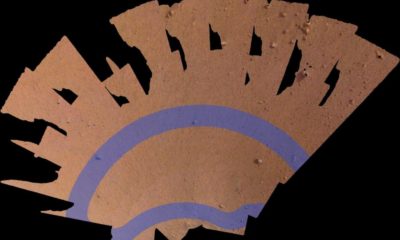

Évoluant dans un « trafic » ou environnement dédié; par exemple le robot spatial dans l’architecture modulaire de la Station Spatiale Internationale, le système de traitement de données dans la database (base de données), le robot aide-soignant dans le diptyque médecins-patients etc, le système automatisé se doit de connaître, maîtriser voire prévoir et même organiser son environnement de travail et d’évolution.

Plus particulièrement quand ledit système automatisé est conçu comme système de décision agissant en conséquence. Ainsi en est-il de tout système de décision comme l’entreprise commerciale, qui doit connaître son environnement (règlementaire, concurrentiel, fiscal etc), l’armée le terrain et les forces en présence, l’homme son environnement et ses semblables, l’automobiliste les autres usagers de la route, l’animal et le végétal les autres êtres vivants dans une existence fondée sur l’empathie le qui-vive où la survie et l’entraide font loi.

Actuellement, les systèmes automatisée sont d’une sorte; ils agissent dans et sur un environnement dans lequel ils n’ont pas à s’adapter aux changements des autres intervenants, vivants ou cybernétiques -pour peu qu’il y soit d’autres intervenants, le système automatisé actuel étant comparable à un fils unique seul dans sa chambre, auquel ses parents, c’est à dire les concepteurs et utilisateurs du système automatisé, assigne des tâches mais avec qui ses parents n’interviennent pas dans les tâches du quotidien, exemple le rangement de sa chambre.

Prenons le cas du robot aide-soignant, il ne s’adaptera pas -à ce stade technologique actuel- à l’état ou la forme du médecin ou du patient pour effectuer sa mission, du moins ne sera t-il pas premièrement conçu à cet effet.

Il en sera de même pour le robot mécanicien de la Station Spatiale Internationale qui n’effectuera pas sa tâche sur la base d’une interaction complète avec d’autres machines ou avec un astronaute. Pourtant, si ce mécanicien automatisé se doit de prendre des décisions et d’agir en conséquence, il doit être pensé pour interagir de manière optimale avec son environnement.

De surcroît lorsque son environnement n’est pas un environnement figé, passif, mais un environnement en constant mouvement, subissant -ou provoquant- un changement permanent. Nous remarquons que la cybernomie actuelle (la science des systèmes automatisés complexes) regorge encore des possibilités d’ajustement et d’innovation remarquables.

Les systèmes automatisés du futur devront être conçu comme des systèmes de décision capable de « communiquer », interagir pleinement et véritablement avec des systèmes de décision tiers analogues (c’est à dire automatisé) ou non (par exemple l’homme, où l’animal dans le cas d’un robot vétérinaire autonome).

À défaut, ils ne pourront être intégrés à la vie quotidienne et pratique de l’humanité dans les décennies et siècles à venir. Cantonnés à l’exécution d’un programme préétabli par l’homme, les systèmes automatisé seront alors au mieux autonome dans un cadre infra-système, c’est à dire dans un environnement dédié, mais incapable d’être responsable dans un environnement d’interaction inter-systèmes.

Pour comprendre la spécificité de la question des systèmes automatisés, nous devrons nous pencher sur ce que c’est que l’automatisme, ses missions, ses fonctions et les problématiques qui se posent avec son développement. Nous rencontrerons de interrogations, des incohérences ou des problèmes sur notre route. Nous essayerons de faire émerger des solutions pour que les erreurs technologiques et les fautes organisationnels auxquelles nous seront peut-être confrontés dans le futur ne se manifestent pas au moment où l’humain n’aura plus aucune prise sur la machine, et où l’erreur, inhumaine cette fois, causera des crises et des malheurs à la vie terrestre toute entière.

Car dans le cadre des systèmes automatisés, « l’erreur inhumaine » dérivera tout d’abord d’une certaine erreur humaine de conception du système automatisé.

Voyons donc comment concevoir le Système automatisé du futur, sûr, utile et responsable, puisque déjà il étend son champ d’action au sein de nos vies, et continuera davantage, non pas de manière autonome, mais de par la volonté des hommes. C’est donc cette volonté qui doit être traité, non pas en elle-même, mais en son origine.

Comme évoqué au commencement de cette article, l’objectif est le moteur de l’action, mais surtout la cause du choix. Or les choix sont globalement de deux sortes; ceux qui nous sont en quelque sorte imposés et qui sont des choix de réaction, d’adaptation, et qui découlent du quotidien, du moment. Cette première catégorie de choix relève de la tactique. La seconde catégorie de choix, bien qu’elle puisse être influencé voire causé par des évènements externes, est celle des choix dont la source principale est l’individu décidant lui-même.

Cette seconde catégorie de choix est du ressort de la stratégie murie, réfléchie, en un mot, du plan, tandis que la première est de celle de la manœuvre et de l’adaptabilité permanente.

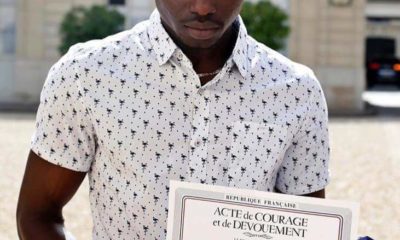

En ce qui concerne la réflexion que nous allons dédiée à l’avenir de la Cybernomie (cybernomism pour les anglophones), c’est à dire à la science et l’industrie des cybernômes (cybernomata en anglais), dits systèmes automatisés complexes, nous allons nous appuyer sur un évènement qui a considérablement choqué le monde entier et fait émerger des questions sur l’industrie cybernomique, à savoir l’accident mortel impliquant une voiture autonome dans la ville de Moutain View (Californie) aux États-Unis, le 19 mars de cette année 2018.

Ce fait- divers « high-tech » qui a causé la mort d’une passante, percuté par la voiture autonome, nous émeut et peut, dans un premier temps, entraîner un sentiment de perplexité, voire de rejet vis-à-vis de la cybernomie automobile. Puis amener des interrogations d’ordre général sur le futur de la voiture autonome, et sur les circonstances de l’accident, afin de dédouaner les uns et (dé)charger les autres. La question ne portera ainsi que sur la forme du problème. Mais nous, nous chercherons à connaître le fond, poserons les questions qui dérivent de la chose considérée en elle-même, pour faire émerger des réponses utiles et adaptées à la gravité réelle et insoupçonnée de ce qui se joue sous nos yeux.

Et nous ferons cela sans nous arrêter à la simple réaction, ni à l’adaptation ou à la configuration nouvelle de la question de la Cybernomie, ni à la progression purement tacticienne de notre pensée et de nos projections.

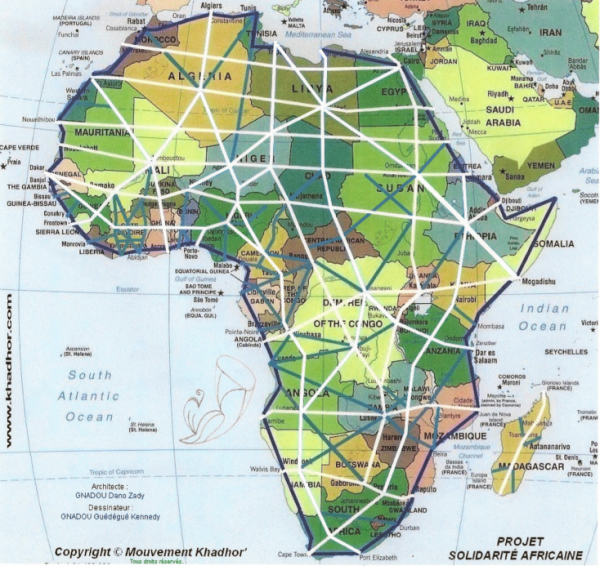

Nous devrons en revenir au fondement, réfléchir précisément et exactement, pour pouvoir, en ayant gagné une compréhension parfaite de la Cybernomie sous tout ses aspects (scientifique, technique, philosophique, environnementale, économique et géographique) en dégager une perspective viable et durable pour ceux qui la conçoivent et pour qui elle est conçue : les humains.

Partons donc à la conquête du savoir et de la réflexion cybernomique, pour déterminer ce qui doit être étudié en ce qui concerne la voiture autonome, afin de dégager des pistes et résoudre l’équation cybernomique dont l’inconnu (ou les inconnues, nous verrons cela en détail dans la deuxième partie de cet article) ne semble pas avoir été à ce jour clairement définie.

GNADOU ATHYTHEAUD pour K1fo

A SUIVRE DANS VOTRE JOURNAL : La Cybernomie à l’Epreuve du Monde: Quand l’erreur sera Inhumaine (Partie II) ! A Lire en exclusivité sur K1fo.info !

Facebook

Twitter

Pinterest

Google+

RSS